GoogleのマルチモーダルLLM「Gemini.1.5 Flash」の精度を検証してみる

参考: https://x.com/googledevs/status/1796212793802101118[1]

参考: https://x.com/googledevs/status/1796212793802101118[1]

Gemini 1.5 Flash の特徴

Gemini 1.5 Flashは、実行速度とコストの低減を求める開発者の要望に応えるために大規模な大量のタスク向けに構築されました。このモデルはGeminiファミリーモデルの中でも、最も高速かつコスト効率が高いとされています。また、デフォルトで 100 万トークンのコンテキスト ウィンドウがあり、1 時間のビデオ、11 時間のオーディオ、30,000 行を超えるコードを含むコードベース、または 700,000 語を超えるコードを処理できます。

| Model | Context-window ( tokens ) |

Price(/1M tokens) |

|---|---|---|

|

Gemini 1.5 Pro[2]

|

2,000,000 |

FreePlan : input: $0.0, output:0.0 Over 128k tokens : input: $1.70, output: 2.10 |

|

Gemini 1.5 Flash |

1,000,000 |

FreePlan : input: $0.0, output:0.0 Over 128k tokens : input: $0.70, output: 2.10 |

|

GPT-4o[3] |

128,000 |

input: $5.00, output:15.00 |

|

Claude 3 [4] |

200,000 |

Haiku : input: $0.25, output:1.25 Sonnet : input: $3.00, output: $15.00 Opus : input: $15.00, output: $75.00 |

Gemini 1.5 Flash の性能

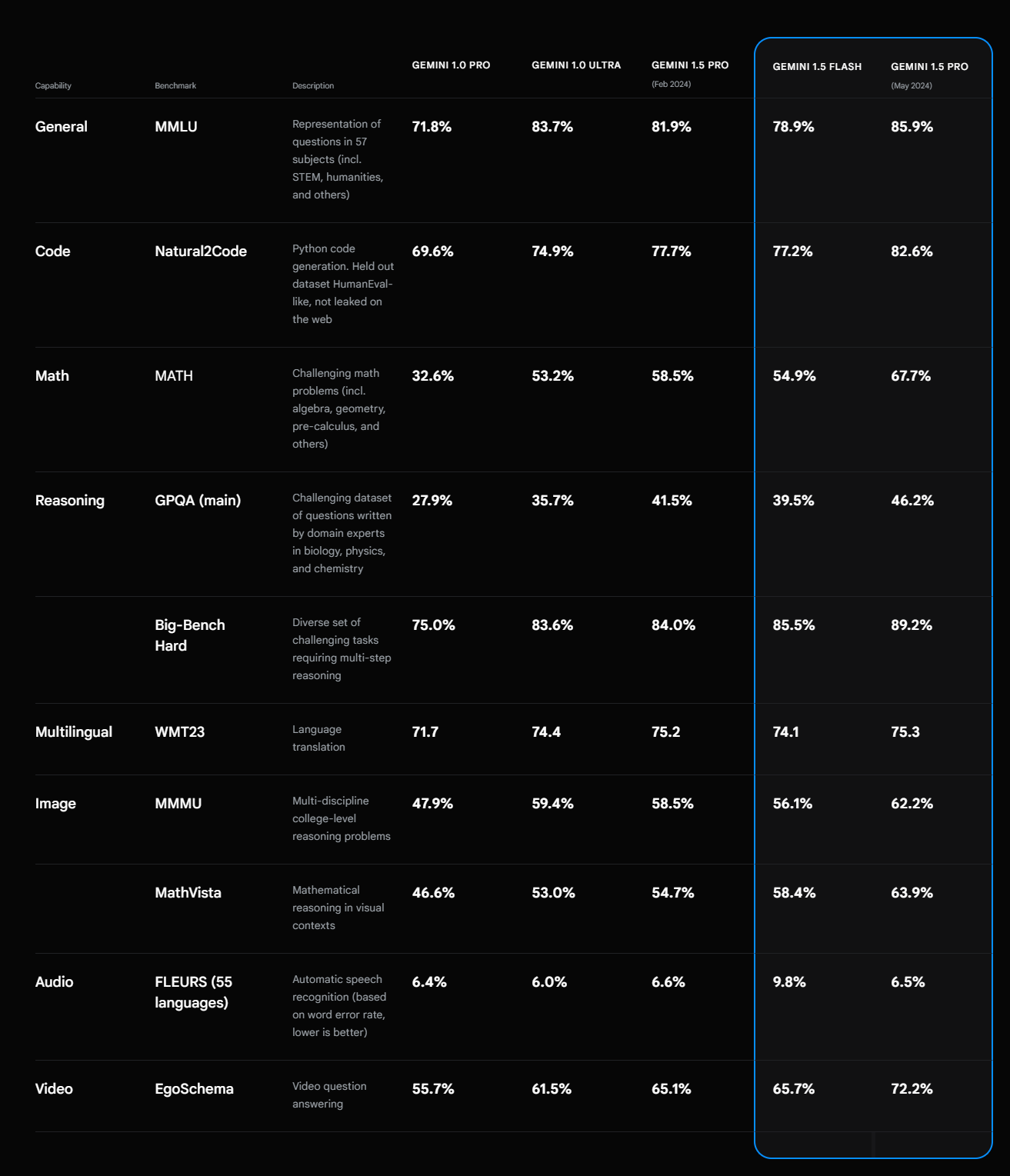

公式より各 Gemini モデルのベンチマークテスト結果が公開されており、Gemini 1.5 Flashはコーディングや数学、推論、画像、音声、動画等の様々なタスクにおいて旧モデルのGemini 1.0 Proを上回る性能を持つことがわかります。さらに、一部のタスクではGemini 1.0 Ultraを上回るスコアを得ています。

Geminiファミリーモデルのベンチマークテスト結果一覧

Geminiファミリーモデルのベンチマークテスト結果一覧

詳細はテクニカルレポート[5]をご確認ください。

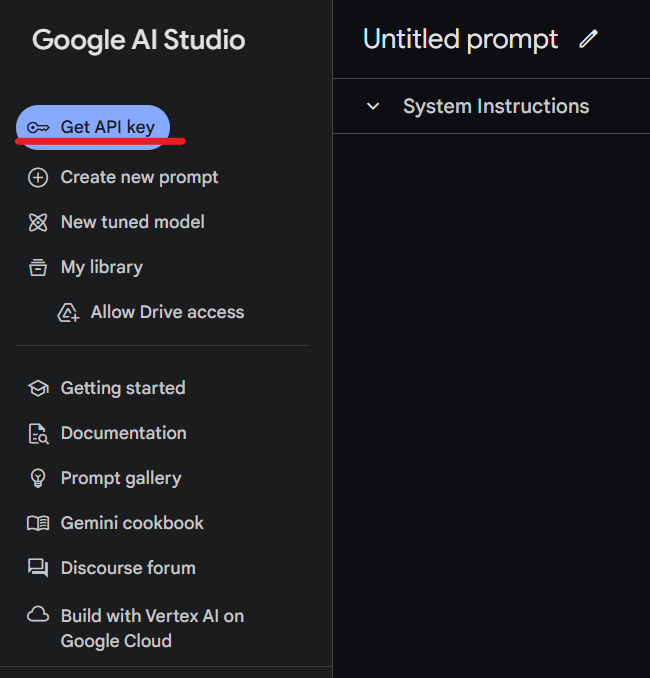

Gemini 1.5 Flash の使い方

「Gemini 1.5 Flash」は、Google AI Studio及びVertex AIで利用することができます。今回はGoogle AI Studioを用いてGemini 1.5 Flashを動作させてみましょう。

API Key の取得

まず、Google AI Studioの画面左上の「Get API key」からAPI キーの取得画面へ移動します。

画面移動後、「APIキーを作成」を選択することでAPI Keyを作成することができます。作成したAPI Keyは、下表のAPIキーに該当します。

実行

pip install google-generativeai モデル名を`models/gemini-1.5-Flash`と指定することで利用できます。また、モデルの読み込み時に先ほど取得したアクセストークンを指定します。

from google import generativeai

generativeai.configure(api_key=$YOUR_API_KEY)

video_path = $YOUR_VIDEO_PATH

model_name = ‘models/gemini-1.5-flash’

model = generativeai.GenerativeModel(model_name)

uploaded_video = generativeai.upload_file(video_path)

while uploaded_video.state.name == "PROCESSING":

print("Waiting for processed.")

time.sleep(10)

uploaded_video = generativeai.get_file(uploaded_video.name)

response = model.generate_content([$YOUR_PROMPT, uploaded_video])

print(response.text) 詳細は、公式Documents[6]をご確認ください。

Gemini 1.5 Flash に動画内容を質問してみる

Gemini 1.5 Flash にビデオの内容に関して質問し、どのような応答が得られるか確認してみましょう。今回は、過去のGoogle I/O Japanの動画を対象に日本語による説明を実施します。

▼対象の動画

1. Prompt=“この動画を日本語で説明してください”

<結果>

この動画は、Google I/O Extended Recap Live Japan 2019についてのものです。

動画は、Google I/O 2019 のイベントの様子から始まります。Google I/O は、毎年開催される Google の開発者向けのカンファレンスです。今年はカリフォルニア州マウンテンビューの会場で開催され、7,000 人以上の開発者や関係者が参加しました。

動画では、Google I/O のキーノート講演や、会場の様子、製品や技術の発表、さまざまなセッションの様子が映し出されています。

Google I/O 2019 の全体的なテーマは、「Building a more helpful Google for everyone」でした。これは、Google がより役立つ Google を、すべての人々に向けて構築していくという意思表示です。このテーマは、Google が開発しているさまざまな技術や製品の開発や提供において、重要な指針となっています。

動画の後半では、Google I/O Extended Recap Live Japan 2019の開催について説明しています。これは、Google I/O 2019 の内容を、日本の開発者に向けて日本語で詳しく解説するイベントです。

Google I/O Extended Recap Live Japan 2019では、Android、Google Play、Firebase、Machine Learning/AI、Web、Chrome、Google Nest Hubなど、Google のさまざまな製品や技術について、専門家たちが詳しく解説しています。また、Google が開発している新しい技術や製品、サービスについて、最新の情報を提供しています。

動画では、イベントの概要や注目ポイントなどを紹介しています。また、イベントに参加できない開発者に向けて、オンラインでの視聴方法についても説明しています。

Google I/O Extended Recap Live Japan 2019は、日本の開発者にとって、Google の最新技術や製品、サービスに関する情報を収集し、理解を深める絶好の機会です。ぜひ、この動画を参考に、イベントに参加して、最新の情報をキャッチアップしてください。

説明には、「 Google I/O 2019 の全体的なテーマは、「Building a more helpful Google for everyone」でした。…」といった動画内の話者が話している内容だけでなく、「 Google I/O のキーノート講演や、会場の様子、製品や技術の発表、さまざまなセッションの様子が映し出されています。… 」のようにどのような映像が流れていたのかも記述されており、動画全体を上手く説明できていることがわかります。

2. Prompt = “この動画の内容を文字起こししてください”

この質問の応答は動画全体の文字起こしとなり、かなり文字数が多くなるので一部を抜粋して紹介します。

<結果1 >

みなさんこんにちは。Google Developer Advocate の松内良介です。 Google I/O Extended リキャップライブジャパン 2019 が始まります。 Google I/O とは 年に1回 Google の製品やサービスの技術的な発表を行う開発者会議です。 Google I/O Extended リキャップライブジャパン 2019 では アメリカの現地会場で参加できなかった皆さんにも アイオーの情報 を日本語でしっかりとお伝えできればと思います。 私からは 技術的な案内や支援 を担当している Google 社員の視点で 今年のGoogle I/O の発表内容や製品情報 を振り返りたいと思います。 他に も 各製品担当が さまざまな製品の発表内容 をご紹介します。 この場でお伝えする内容が 皆さんの お役に立てば幸いです。 なお、本日のイベントでは Twitter でライブ質問を受け付けております。 ハッシュタグ #RecapLiveJP を付けてご質問下さい。 セッション中に頂いた質問には セッションが終了した後に お答えいたします。 セッションの様子は後日 Google Developer Japan YouTube チャンネルでも公開いたします。 それでは Google I/O Extended リキャップライブジャパン 2019 まもなく始まります。n/ I/O FROM MOUNTAIN VIEWn5nTO TOKYOnI/O EXTENDED RECAP LIVE JAPAN 2019 はい、みなさんこんにちは。Google の Developer Advocate の松内良介と申します。今日は Google I/O 2019 で Google が発表した内容についてご紹介します。

こちらは序盤部分の文字起こしですが、動画での発言をほぼ正確に記載しています。また、「 I/O FROM MOUNTAIN VIEW 」「 TO TOKYO」「I/O EXTENDED RECAP LIVE JAPAN 2019 」は画面上に表示された文字であり、音声と映像ともに文字起こしできています。

<結果2>

Google I/O は、今回で 13 回目の年次開催会議 7000 人以上の開発者、関係者が参加 100 件以上の製品、技術発表 179 件の講演動画 (YouTube) 講義講演 1. 基礎機能 – 最新 API 2. 最新技術 – 最適化、新しい UI など 3. 研究の現状 – 機械学習 4. アニメーション、音声合成 – 初学者をさだめての 5. 実際的な開発ハックやテクニックの共有 – ゲーム開発の技術 現地会場 6. 製品デモ展示(Sandbox) 7. コミュニティプログラミング体験コーナー 8. 質問応答コーナー(Office Hours、App Reviews) 9. 参加者バッジの交換コーナー Google I/O は 今回で 13 回目となります。 今回 もさまざまな国から 7000 人以上の 開発者の皆様、関係者の皆様にご参加いただきました。 そして Google からは 100 件を超える 製品だったりサービス技術の発表 を行いました。 会場についてですが 基礎講演 を含めて 今現在 179 件の 講演の動画が YouTube で公開していますので こちらもぜひよろしくお願いいたします。 Google I/O という イベントには、あの 主に このような内容が含まれています。 もちろん 基礎講演 Google の製品、新技術 についての 重要な発表 デベロッパー向けの 開発ツールや新しい API についての 講演動画 Google I/O は 今回で 13 回目となります。 今回 もさまざまな国から 7000 人以上の 開発者の皆様、関係者の皆様にご参加いただきました。 そして Google からは 100 件を超える 製品だったりサービス技術の発表 を行いました。 会場についてですが 基礎講演 を含めて 今現在 179 件の 講演の動画が YouTube で公開していますので こちらもぜひよろしくお願いいたします。

こちらは画面の説明が表示されるとともに、演者がその説明をしている箇所の文字起こしです。一番最初に画面に表示されている部分(1〜9のトピック)が文字起こしされ、続いて演者の解説となっていますが、画面の説明時に混ざっていた演者の解説とその後のセリフとが重複して同じ内容がくりかえされています。また、「9. 参加者バッジの交換コーナー Google I/O は 今回で 13 回目となります。 今回 もさまざまな国から …」のようにスライド部分と演者のセリフが明確に分かれていないため、やや読みにくい文章が生成されています。

Gemini 1.5 Flash のまとめ

本記事では、Google社が提供するLLMの「Gemini 1.5 Flash」についてご紹介しました。

Gemini 1.5 Flashの活用で、動画内容についてある程度説明や文字起こしができることが確認できました。ただ、文字起こしでは映像と音声の表記分けの点で課題が残るように思えます。今回は「文字起こしをしてください」とだけ指定しているため、明確にわけるように指定をすれば結果が変わるかもしれません。

FlashモデルはProモデルと比べて、トークンあたりのコストを10分の1に抑えることができます。特に、他社で公開されているGPT-4oやClaude 3はマルチモーダルLLMではありますが、現状ではAPIでの動画の処理に対応していません。そのため、コストを抑えつつ動画内容をLLMによって処理したい場合には、 Gemini 1.5 Flash が適しているといえるでしょう。

【参考文献】

[1]https://x.com/googledevs/status/1796212793802101118

[2]Gemini API の料金 | Google AI for Developers | Google for Developers

[5](gemini_v1_5_report.pdf (storage.googleapis.com))

[6](cookbook/quickstarts/Video.ipynb at main · google-gemini/cookbook · GitHub)

お問い合わせ・

導入のご相談

AI導入や活用についての

ご質問・ご相談はこちらから。

現状の課題やお悩みをもとに、

最適な進め方をご提案します。

資料ダウンロード

調和技研の事業や事例集をご覧いただけます。

AI活用の全体像を知りたい方におすすめです。